Jakie zagrożenia dla ludzkości ze strony SI ukrył szef OpenAI Sam Altman?

Przez te kilka dni, kiedy ważą się nie tylko losy założyciela OpenAI, ale również całej branży sztucznej inteligencji i przyszłość miliardów dolarów zainwestowanych przez fundusze inwestycyjne w spółki nowych technologii, gazety biznesowe prześcigają się w spekulacjach, co takiego ukrywa przed światem i radą dyrektorów Sam Altman. Już kilka godzin po zwolnieniu proszący o anonimowość członek zarządu firmy zdradza, że przy zwolnieniu w grę wchodziła nie tylko przyszłość pierwszej światowej firmy, lecz także całej ludzkości.

Altman wiedział, nie powiedział

Założona przez Altmana firma OpenAI już wiele miesięcy wcześniej stała się światowym pionierem w zarządzaniu działem badań naukowych - powołała do życia sztuczną inteligencję, która już po kilku pierwszych tygodniach nie tylko zabawiała rozmowami zafascynowanych nową zabawką amerykańskich i japońskich emerytów, ale jak świat szeroki pisała prace zaliczeniowe dla studentów we wszystkich językach świata, a nawet prace doktorskie z prawa międzynarodowego, czy - na czym dość szybko dała się złapać - także projekty ustaw w wielu krajach, które bezrefleksyjnie trafiały pod obrady parlamentów. Przede wszystkim jednak jako pierwsza korporacja w świecie nowych technologii zaczęła zatrudniać filozofów i etyków, których głównym zadaniem było określenie, na ile niebezpieczne i antyludzkie jest narzędzie zdobywające popularność w bezprecedensowym tempie, bijąc na głowę ilością logowań i odsłon nie tylko rekordy serwisów społecznościowych, ale także… bezkonkurencyjnej w skali planety przeglądarki Google.

"Za zwolnieniem Sama Altmana stoją obawy o zbyt szybki rozwój sztucznej inteligencji i związany z tym niepokój o bezpieczeństwo nie tylko firmy i jej produktu, ale przede wszystkim całej ludzkości" - donoszą dobę po zwolnieniu Altmana "New York Times" i agencja Bloomberg. Nowy zarząd OpenAI nie komentuje tych doniesień, ale - co symptomatyczne - nie zaprzecza im. Zamiast tego tymczasowy dyrektor wykonawczy OpenAI Emmett Shear zapowiada przeprowadzenie dochodzenia w sprawie nagłego i nieoczekiwanego zwolnienia z pracy założyciela firmy.

W ciągu kilku godzin od tego zdarzenia w amerykańskich i zachodnioeuropejskich mediach pojawiły się głosy naukowców potwierdzające ten zarzut.

- Wzmianka w komunikacie o zwolnieniu Altmana mówiąca o tym, że "nie był konsekwentnie szczery w swojej komunikacji z zarządem, utrudniając mu wykonywanie jego obowiązków", oznacza, że biznesmen zatajał informacje, które kolidowały z obowiązkami zarządu, by zapewnić bezpieczny rozwój AI - deklaruje Toby Ord, filozof i jeden z liderów ruchu efektywnego altruizmu, który zakładał razem z Altmanem pod koniec drugiej dekady obecnego wieku. Ruch od lat przestrzega przed oddawaniem zbyt dużej władzy sztucznej inteligencji, która już dzisiaj wymyka się spod kontroli. ChatGPT - wciąż przez wielu użytkowników uważany za zabawkę - pokazał już, że potrafi nie tylko świetnie pisać i udawać człowieka w rozmowach, ale przede wszystkim potrafi doskonale kłamać. Dopóki chodzi o zjawisko "halucynowania SI" - czyli wymyślania na poczekaniu historii, które się nie wydarzyły - jest to dość zabawne, jednak ChatGPT (i podobne boty stworzone przez konkurencyjne firmy - m.in. Google i Microsoft) potrafi również podrabiać styl, głos a nawet tworzyć materiały video z wypowiedziami żyjących i nieżyjących polityków, które nigdy nie padły.

SI w służbie dezinformacji

Trzeba pamiętać, że podobne sztuczne inteligencje powstały i są wykorzystywane także w krajach, które z demokracją mają niewiele wspólnego - Chiny z powodzeniem zatrudniły SI do stworzenia nieprawdziwych prezenterów telewizyjnych, którzy bez mrugnięcia okiem czytają wiadomości, mówiąc nierzadko o zachwycie całego świata nad pokojowym i stabilnym rozwojem Chin stających się nowym światowym liderem gotowym do zastąpienia, a nawet wyeliminowania Stanów Zjednoczonych. W tym samym czasie podobne algorytmy tworzone przez Rosję przekazują Rosjanom informacje o sukcesach rosyjskiej operacji specjalnej na Ukrainie, a nawet o przyjaznym witaniu przez pragnących spokoju i stabilności Ukraińców rosyjskich sił na wschodzie zaatakowanego kraju, jednocześnie pokazując w ukraińskich serwisach społecznościowych nieistniejące kłótnie w ukraińskim sztabie generalnym.

Do pierwszej ligi w rozwoju sztucznej inteligencji wchodzą również Arabowie. Oto Arabska Rada ds. Badań nad Zaawansowanymi Technologiami z siedzibą w Abu Zabi dokonuje na przełomie listopada i grudnia śmiałego kroku, tworząc nową, w zapowiedziach największą firmę z branży sztucznej inteligencji - AI71. Podmiot powstaje w oparciu o stworzone przez arabski Technology Innovation Institute modele generatywnej sztucznej inteligencji Falcon i skupi się na wielodomenowych specjalizacjach, oferując zarazem niedostępne wcześniej opcje sterowania danymi AI dla firm i krajów, które zamierzają podjąć się self-hostingu dla ochrony prywatności i tajemnic państwowych.

Kto wyłączy SI?

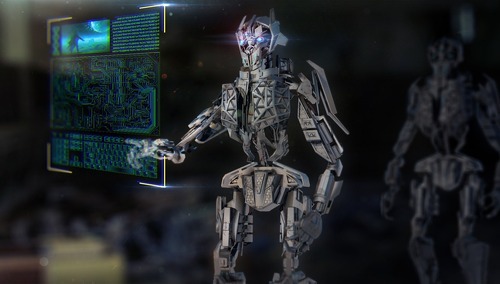

Przeciwnicy niekontrolowanego rozwoju sztucznej inteligencji podkreślają, że żadna z tych firm i organizacji nie potrafi odpowiedzieć na pytanie od lat stawiane przez ruch efektywnego altruizmu: Czy ponad wszelką wątpliwość firmy zajmujące się rozwojem SI mają pewność, że istniejące na świecie sztuczne inteligencje nie połączyły się i nie współpracują ze sobą, kształtując świat nie według oczekiwań ich twórców, lecz według projektu, o którym ludzie nie mają pojęcia. - A to właśnie największe niebezpieczeństwo, skoro SI zarządzają już największymi elektrowniami atomowymi, kolejami, gigantycznymi bazami danych, a nawet autonomicznymi samochodami - przestrzega Toby Ord. - Nie mamy nawet pewności, czy te wszystkie algorytmy dadzą się dzisiaj wyłączyć - mówi filozof.

Tekst pochodzi z 50 (1820) numeru "Tygodnika Solidarność".

Denzel Washington: Decydujące znaczenie ma moja relacja z Bogiem, wszystko inne jest drugorzędne

Ojciec Święty Leon XIV odrzucił propozycję stworzenia „sztucznego papieża” AI

"Potrzeba restrykcyjnych procedur". Etycy krytykują nową technologię Muska

Światowa awaria ChatGPT. Ponad tysiąc raportów z Polski

Sztuczna inteligencja zadecyduje o Twojej pracy? O rewolucji w HR na Forum w Karpaczu